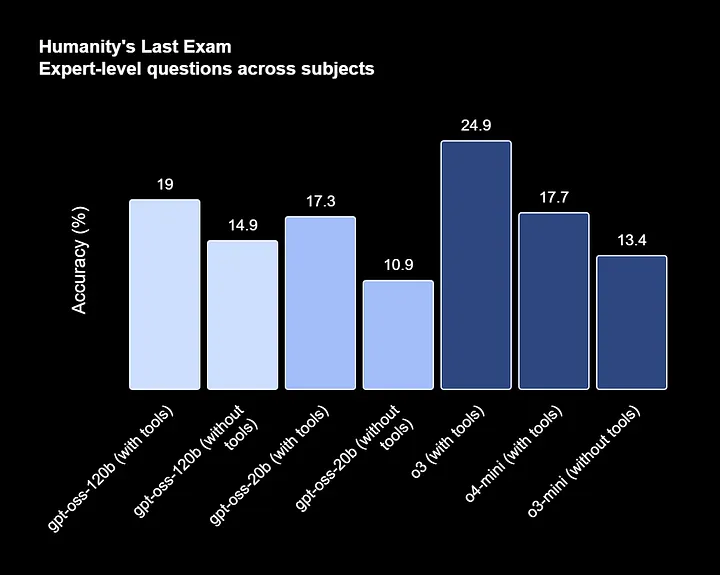

Recientemente OpenAI lanzó dos nuevos modelos de lenguaje de pesos abiertos: gpt-oss-120b y gpt-oss-20b, los cuáles superan a sus competidores en tareas similares de razonamiento y tienen buenas capacidades en lo que respecta a la eficiencia de uso de hardware. Estos nuevos modelos abren la puerta a un sin fin de posibilidades para desarrolladores y pequeñas empresas.

OpenAI menciona que el modelo gpt-oss-20b puede ser ejecutado en dispositivos con 16GB de RAM, lo que incluso abre la posibilidad de poder ejecutarlo en computadoras personales y smartphones de gama alta.

En el caso que quieras profundicar más sobre estos modelos, puedes visitar el Presentación de gpt-oss.

Qué es un Modelo de pesos abiertos?

Un modelo de pesos abiertos es un modelo de inteligencia artificial cuyos pesos resultantes del entrenamiento son accesibles públicamente. Esto no significa que el código y datos de entrenamiento del modelo esten disponibles, sino que los pesos del modelo en sí pueden ser descargados y utilizados por cualquier persona.

Luego de esta breve introducción, veamos cómo ejecutar el modelo gpt-oss-20b localmente, ya que es el modelo más liviano de los dos.

Ejecutando el Modelo gpt-oss-20b

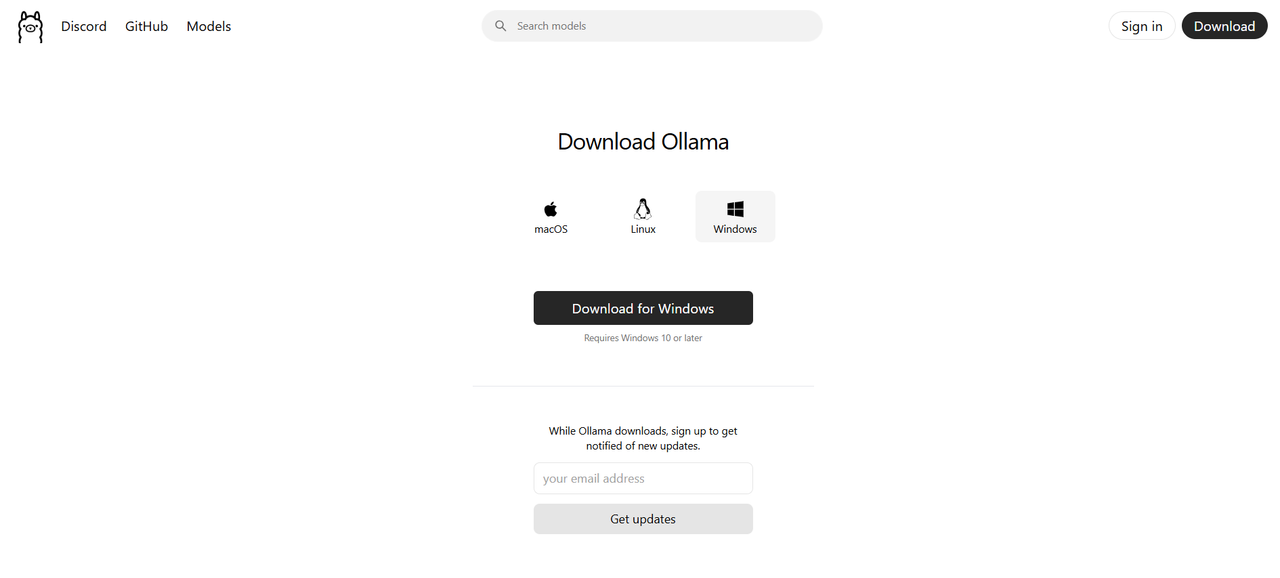

Paso 1: Instalación de Ollama

-

Visita el sitio web oficial de Ollama.

-

Selecciona la opción correspondiente a tu sistema operativo.

-

Descarga el archivo y ejecuta el archivo de instalación.

-

Una vez completada la instalación, se abrirá una ventana con la UI de Ollama.

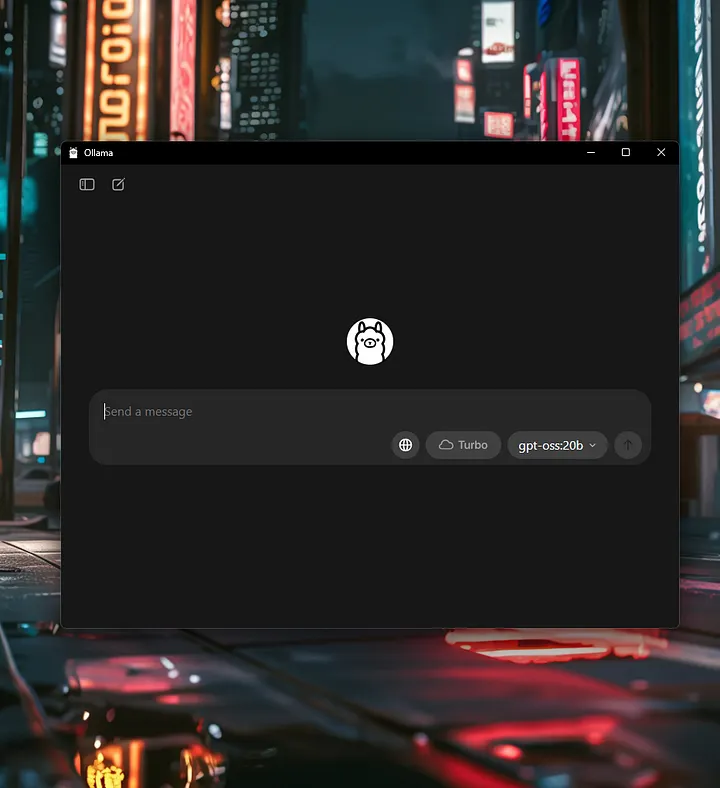

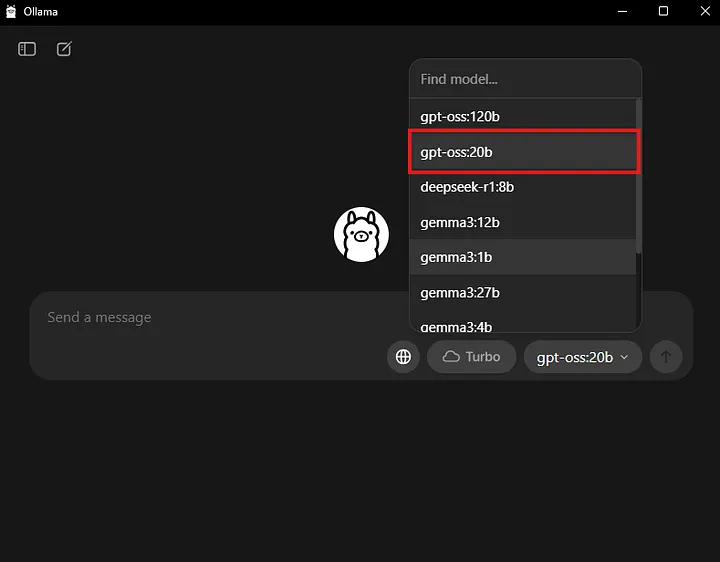

Paso 2: Descargar el Modelo gpt-oss-20b

-

Selecciona el modelo

gpt-oss-20ben la interfaz de usuario.

-

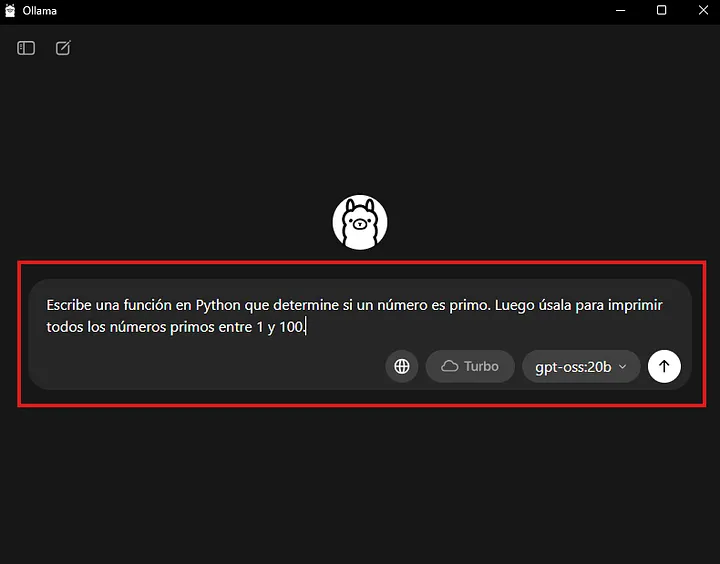

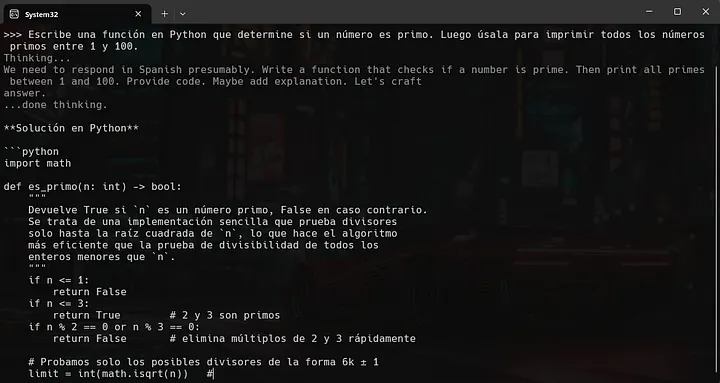

Escribe un mensaje en el cuadro de texto, en este caso voy a probar con el siguiente mensaje:

Escribe una función en Python que determine si un número es primo. Luego úsala para imprimir todos los números primos entre 1 y 100.

-

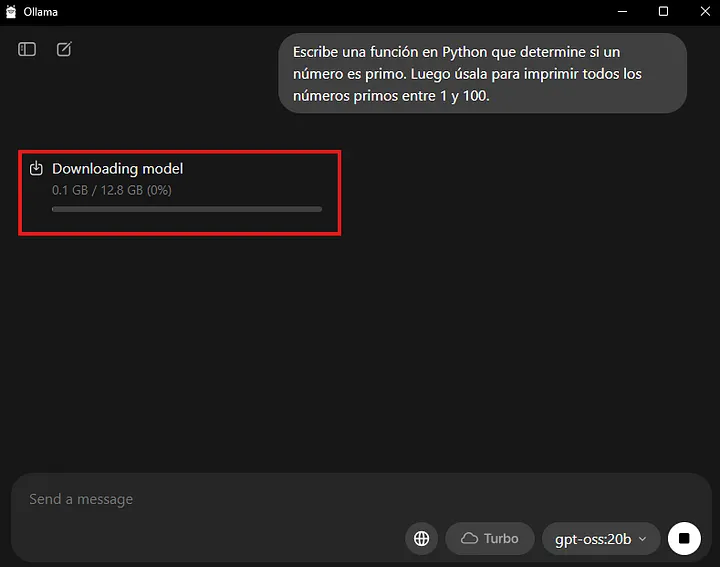

Una vez que hayas escrito tu mensaje, se iniciará la descarga del modelo.

-

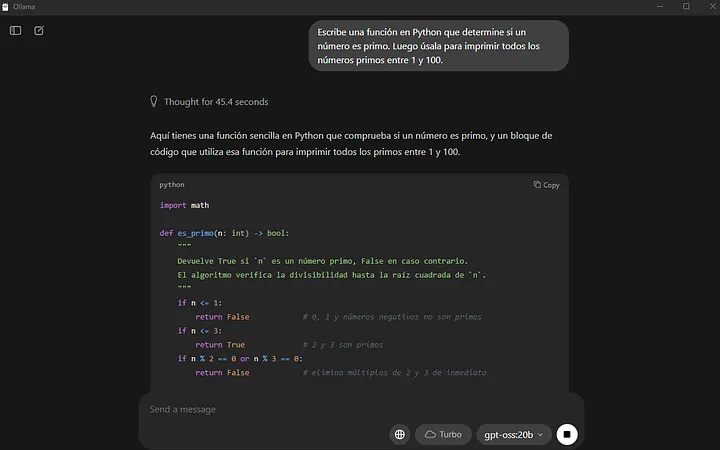

Finalizada la descarga, el modelo comenzará a procesar tu mensaje y lo podrás utilizar localmente.

Paso 3: Descargar el Modelo gpt-oss-20b utilizando la Terminal

-

Abre una terminal o CMD.

-

Escribe el siguiente comando para descargar el modelo

gpt-oss-20b:ollama run gpt-oss:20b -

Espera a que la descarga finalice.

-

Una vez completada la instalación, puedes interactuar con el modelo escribiendo mensajes directamente en la terminal.

Cierre

Espero esta guía te haya sido útil para aprender a ejecutar los nuevos modelos de OpenAI localmente utilizando Ollama. Estos modelos es una gran disrupción en el mundo OpenSource y abren la puerta a un sin fin de posibilidades para desarrolladores y pequeñas empresas.

Hasta la próxima!😁